Verzonden op 31-03-2026 09:36

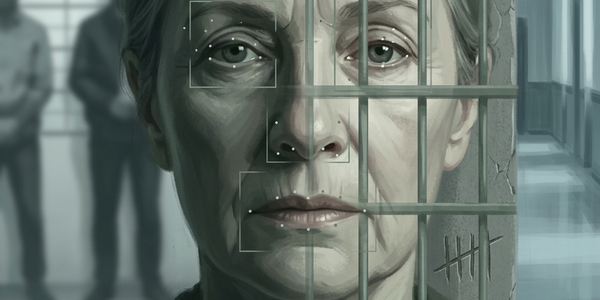

AI-gezichtsherkenning identificeert vrouw foutief; 5 maanden celEen grootmoeder heeft vijf maanden in de gevangenis gezeten nadat AI-gezichtsherkenning haar ten onrechte identificeerde als verdachte. Dit is geen theoretisch risico meer: de consequenties van foutieve AI-output in juridische en overheidscontexten zijn aantoonbaar ernstig. Voor organisaties die AI inzetten bij identiteitsverificatie, screening of risicobeoordeling is dit een directe aanleiding om je validatieprocedures te herzien. Hoeveel menselijk toezicht zit er tussen een AI-conclusie en een beslissing met impact op mensen? Met name in sectoren als HR, financiën en beveiliging geldt: een AI-uitkomst is een hypothese, geen beslissing. Zorg dat er altijd een menselijke check is voordat consequenties volgen. Actietip: inventariseer deze week welke AI-outputs in jouw organisatie direct leiden tot acties zonder menselijke tussenkomst, en voeg daar een reviewstap aan toe.

|

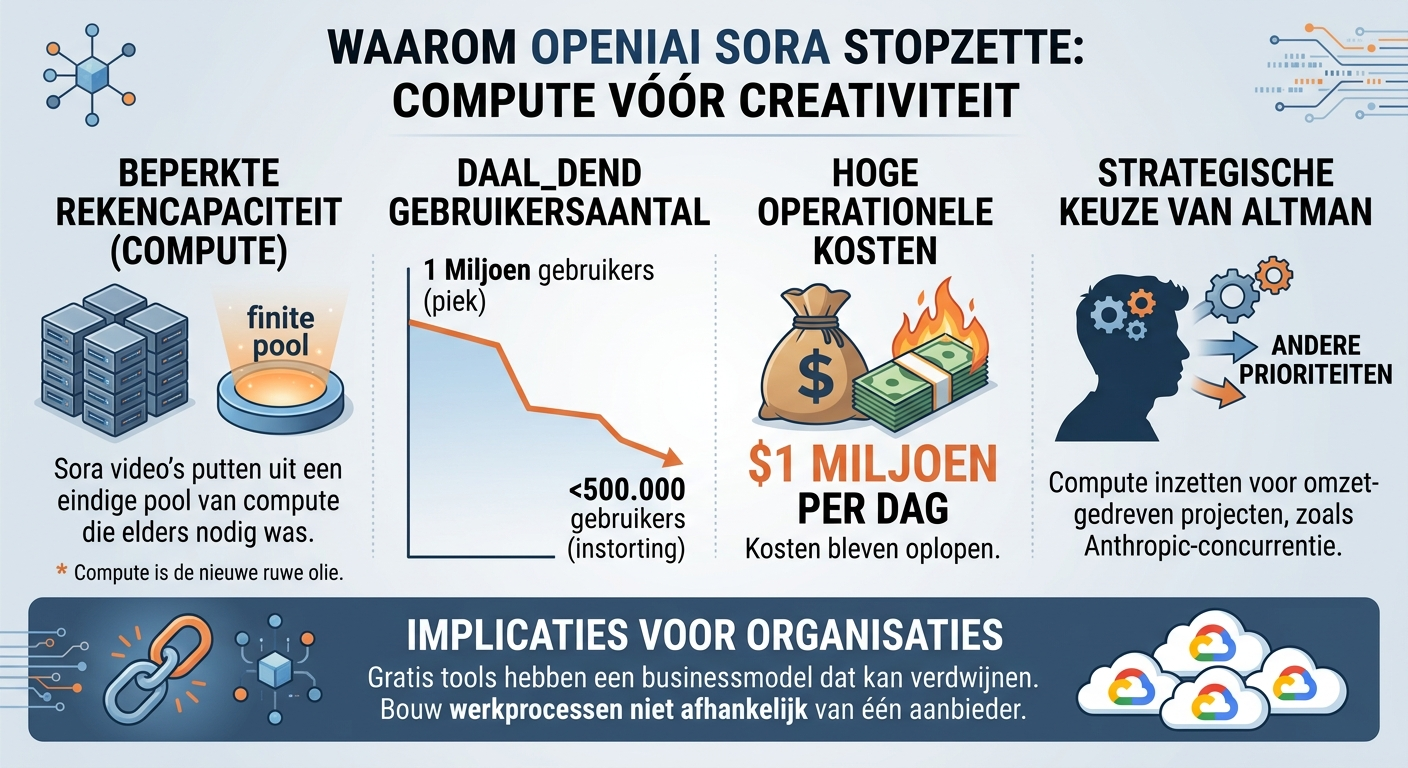

Waarom OpenAI Sora stopzette: compute boven creativiteitOpenAI heeft het Sora-videoplatform gesloten omdat elke gegenereerde video direct ten koste ging van schaarse rekencapaciteit die het bedrijf elders harder nodig had. Op het hoogtepunt trok Sora een miljoen gebruikers, maar dat aantal halveerde snel terwijl de kosten opliepen tot $1 miljoen per dag. Compute is een eindige hulpbron, en OpenAI koos er bewust voor die elders in te zetten. Voor organisaties die rekenen op AI-videogeneratie als onderdeel van hun workflow is dit een herinnering dat gratis tools altijd een businessmodel hebben — en dat dat model kan verdwijnen. Bouw je werkprocessen dus niet te afhankelijk op van één aanbieder. Alternatieve videoplatforms zoals Runway en Kling draaien nog gewoon, dus de optie om AI-video te blijven inzetten blijft bestaan. Wel is dit een signaal dat aanbieders steeds vaker keuzes maken op basis van winstgevendheid, niet gebruiksgemak.

|

Claude Mythos: Anthropics volgende modelgeneratie gelektEen uitgelekt blogbericht suggereert dat Anthropic werkt aan een nieuwe modelfamilie genaamd Claude Mythos, inclusief een nieuw tier genaamd Capybara. Het lek alleen al was genoeg om cybersecurityaandelen in beweging te brengen. Anthropic beschrijft het als een significante stap in capaciteiten op het gebied van cybersecurity, programmeren en redeneren. Er is nog geen officiële releasedatum. De modellen worden op dit moment intern getest. Voor organisaties die Anthropic-modellen inzetten in productie is het vroeg om hierop te plannen, maar het is wel een signaal dat de concurrentiedruk tussen labs hoog blijft. Wees voorzichtig met gelekte informatie als input voor roadmap-beslissingen: tot een officiële aankondiging van Anthropic zijn claims over capaciteiten niet geverifieerd. Houd de officiële Anthropic-blog in de gaten voor bevestiging. |

Gemini laat je chatgeschiedenis overzetten vanuit andere chatbotsGoogle heeft een migratiefunctie toegevoegd aan Gemini waarmee gebruikers hun chatgeschiedenis en voorkeuren vanuit andere AI-tools direct kunnen importeren. Dit verlaagt de drempel om over te stappen aanzienlijk, want het opbouwen van context is een van de grootste redenen waarom gebruikers bij hun bestaande chatbot blijven. Voor teams die overwegen over te stappen van bijvoorbeeld ChatGPT naar Gemini, betekent dit dat continuïteit van gebruik minder een obstakel is. Of Gemini daadwerkelijk een betere keuze is voor jouw usecase hangt uiteraard af van de specifieke taken. Dit nieuws was al opgenomen in de nieuwsbrief van 28 maart, maar de beschikbaarheid is intussen bevestigd. Wie switcht verliest wel de diepere integraties en fine-tuning die specifiek zijn voor het oorspronkelijke platform.

|