Verzonden op 06-03-2026 07:07

Sai: altijd-actieve AI-medewerker van ex-DeepMind-teamSimular, opgericht door voormalige DeepMind-onderzoekers, heeft Sai gelanceerd: een AI-agent die autonoom computertaken uitvoert terwijl jij met andere dingen bezig bent. Sai is ontworpen als een permanente digitale collega die werk overneemt op het niveau van muisklik en toetsenbord — vergelijkbaar met wat Perplexity Computer eerder uitbracht, maar dan als altijd-aan achtergrondproces. Voor organisaties die repetitieve taken willen automatiseren zonder code te schrijven, is dit de categorie om in de gaten te houden. De technologie is vroeg-stadium; wat Sai concreet beter doet dan bestaande tools als Computer Use of Perplexity Computer is op dit moment nog niet onafhankelijk gevalideerd. |

Google biedt Workspace-toegang via commandoregelGoogle heeft gws uitgebracht: een CLI-tool die Drive, Gmail en Calendar via één commandoregel toegankelijk maakt voor scripts en AI-agents. De tool leest Google's API Discovery Service live uit, waardoor nieuwe API-endpoints automatisch als CLI-commando's beschikbaar komen zonder handmatige updates. Voor organisaties die AI-agents willen koppelen aan hun Workspace-omgeving, is dit een concrete versnelling: je hoeft niet meer per Workspace-service een aparte integratie te bouwen. De tool geeft gestructureerde JSON terug, wat directe koppeling met agent-frameworks vereenvoudigt. Kanttekening: gws vereist technische kennis om in te zetten en is vooral bruikbaar voor teams die al met agent-pipelines werken. |

OpenAI vervangt standaardmodel ChatGPT door GPT-5.3-InstantOpenAI heeft het standaardmodel in ChatGPT vervangen door GPT-5.3-Instant. De belangrijkste verbeteringen zitten in gedrag: minder hallucinaties, minder onterechte weigeringen en minder onnodige disclaimers, plus beter gebruik van webzoekopdrachten en kwalitatief betere schrijfuitput. Dit raakt direct alle medewerkers in jouw organisatie die dagelijks ChatGPT gebruiken — zonder dat ze iets hoeven te doen of te betalen. Wie werkt met prompts die zijn afgestemd op eerder gedrag van het model, doet er verstandig aan die opnieuw te testen: de responspatronen kunnen zijn verschoven.

|

Apple lanceert drie nieuwe MacBooks met AI-focus, vanaf 599 dollarApple heeft drie nieuwe MacBooks uitgebracht: de MacBook Neo (599 dollar), de MacBook Air M5 en een vernieuwde MacBook Pro met M5 Pro en M5 Max-chips. De MacBook Neo draait op de A18 Pro iPhone-chip met tot 3x hogere AI-snelheid dan vergelijkbare Intel-laptops. De MacBook Air M5 levert 4x snellere AI-prestaties dan de M4-generatie. De MacBook Pro biedt tot 128 GB unified memory en verwerkt LLM-prompts 4x sneller dan zijn voorganger — relevant als je lokale taalmodellen wilt draaien zonder cloudafhankelijkheid. Is dit het moment om je hardware-beleid te herijken voor teams die intensief met AI werken? Actietip: als je overweegt lokale modellen te draaien voor privacy-gevoelige data, test dan een MacBook Pro M5 Max met een open model als Mistral of LLaMA voordat je een bredere hardware-uitrol plant.

|

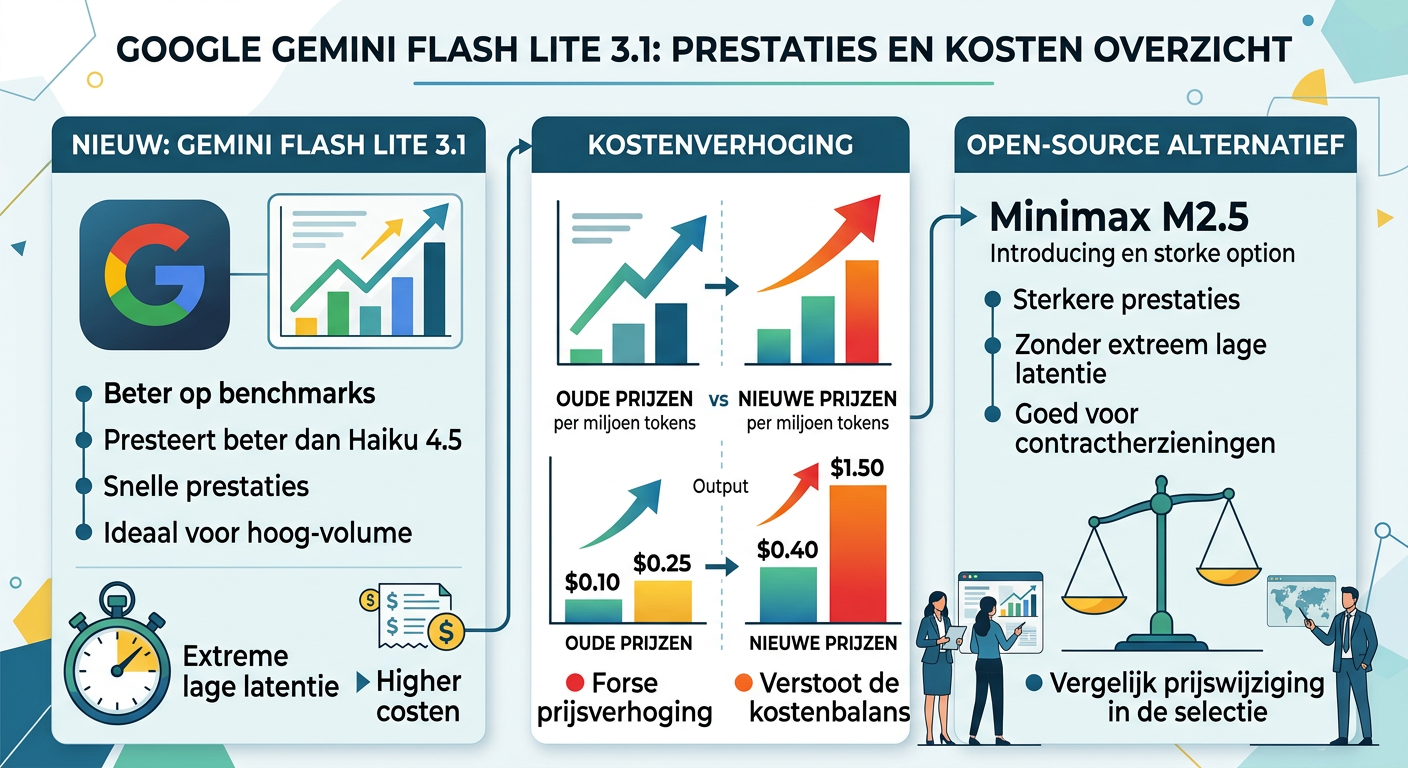

Google Gemini Flash Lite 3.1 beter maar duurder — open-source als alternatiefGoogle heeft Gemini Flash Lite 3.1 uitgebracht, een snel model dat op benchmarks beter presteert dan Anthropic's Haiku 4.5. Maar die prestatiestijging gaat gepaard met een forse prijsverhoging: van 0,10/0,40 dollar naar 0,25/1,50 dollar per miljoen tokens (input/output). Voor teams die Flash Lite gebruiken in hoog-volume toepassingen, kan dit de kostenbalans flink verstoren. Open-source alternatieven zoals Minimax M2.5 bieden sterkere prestaties, zij het zonder de extreem lage latentie die Flash Lite onderscheidt. Wie nu een contractherziening voorbereidt of een nieuw model selecteert, doet er goed aan deze prijswijziging mee te nemen in de vergelijking.

|

OpenAI Codex nu ook op Windows beschikbaarOpenAI's Codex-app, de native codering-assistent met een eigen agent-sandbox, is nu beschikbaar op Windows — na eerder al op macOS te draaien. Dit vergroot de bereikbaarheid voor ontwikkelteams die werken in een Windows-omgeving aanzienlijk. Codex biedt een afgeschermde omgeving waarin de agent code kan uitvoeren en testen zonder risico voor het hoofdsysteem. Voor organisaties die Codex al evalueren op Mac, is dit het moment om de Windows-versie parallel te testen met hetzelfde project.

|