Verzonden op 26-02-2026 08:16

Inception lanceert Mercury 2: diffusie-LLM voor tekstediting in plaats van generatieInception heeft Mercury 2 uitgebracht, een diffusie-based LLM dat niet zelf tekst genereert maar bestaande tekst bewerkt. In plaats van vanaf nul te schrijven, neemt het model jouw ruwe versie en verfijnt het – denk aan herschrijven, tone-aanpassingen of structuurverbeteringen. Dit is nuttig voor organisaties die veel revisiewerk doen: contracten, beleidsnotities, rapportages. Het scheelt tijd doordat je geen prompt meer hoeft te bedenken die de volledige context bevat; je begint met wat je al hebt. Let op: diffusiemodellen kunnen trager zijn dan autoregressive modellen en de kwaliteit hangt sterk af van hoe goed je initiële tekst is. Garbage in blijft vaak garbage out, ook na editing. Test Mercury 2 met één standaarddocumenttype (bijvoorbeeld offertes of samenvattingen) en vergelijk de output met je huidige revisieproces – meet tijd én kwaliteit.

|

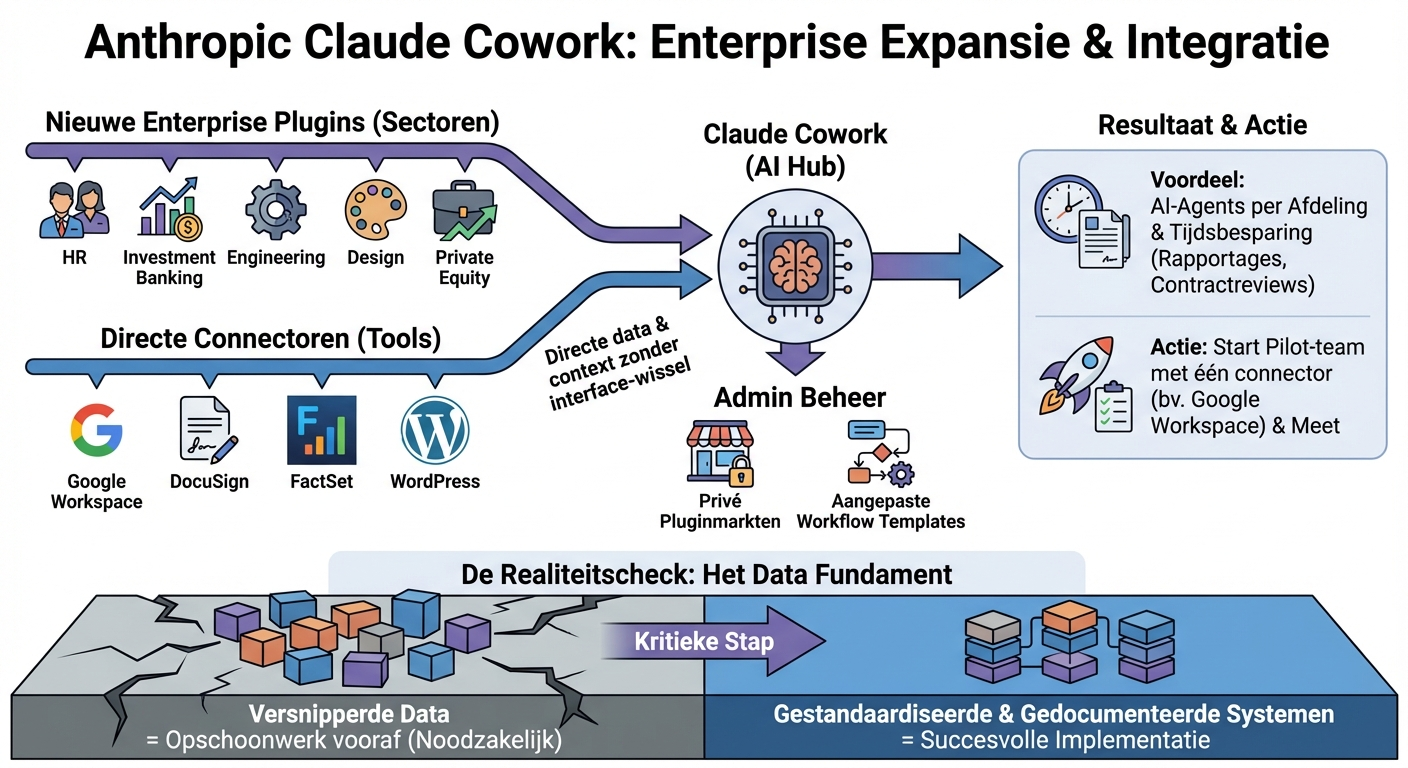

Anthropic breidt Claude Cowork uit met elf enterprise-pluginsAnthropic heeft op 25 februari 2026 een reeks nieuwe plugins voor Claude Cowork gelanceerd, specifiek gericht op HR, investment banking, engineering, design en private equity. Daarnaast zijn er connectoren beschikbaar voor Google Workspace, DocuSign, FactSet en WordPress, waarmee Claude direct context en data uit enterprise-software kan halen zonder van interface te wisselen. Voor organisaties betekent dit dat je AI-agents per afdeling kunt inzetten zonder steeds handmatig data te verzamelen. Admins kunnen nu privé-pluginmarkten opzetten en workflows aanpassen via templates. De realiteitscheck: het succes hangt af van hoe goed je bestaande systemen gedocumenteerd en gestandaardiseerd zijn. Als je data versnipperd is, blijft opschonen voorwerk. Actie: Test één connector (bijvoorbeeld Google Workspace) met een pilot-team en meet hoeveel tijd je bespaart bij standaard kenniswerkprocessen zoals rapportages of contractreviews.

|

Pentagon geeft Anthropic ultimatum over AI-veiligheidsmaatregelenEen senior Trump-administratie-official bevestigde op 25 februari 2026 dat het Pentagon Anthropic een vrijdagultimatum heeft gesteld over AI-safeguards. Dit volgt op berichten dat DeepSeek NVIDIA's Blackwell-chips (verboden voor export naar China) zou hebben gebruikt in een datacenter in Binnen-Mongolië, en dat het bedrijf mogelijk distillatie-technieken van Anthropic, Google, OpenAI en xAI heeft toegepast. Voor bedrijven die werken met Amerikaanse AI-labs betekent dit dat compliance-eisen strenger worden. Denk aan exportcontroles, audittrails en transparantie over waar modellen getraind zijn. De geopolitieke spanning rond chipexport en modeldiefstal maakt de AI-supply chain kwetsbaarder. Verwacht dat contracten met Amerikaanse labs meer clausules over herkomst en gebruik gaan bevatten. Wanneer werk je met gevoelige data of kritieke toepassingen? Controleer dan of je AI-leverancier duidelijkheid geeft over trainingslocaties en compliancegaranties. |

MatX haalt 500 miljoen dollar op voor AI-chipsMatX heeft een financieringsronde van 500 miljoen dollar afgesloten om AI-chips te ontwikkelen. Details over specificaties of release zijn schaars, maar de omvang van de investering wijst op serieuze ambitie om te concurreren met NVIDIA en andere gevestigde chipmakers. Voor bedrijven die afhankelijk zijn van GPU's voor training of inferentie kan meer concurrentie in de chipmarkt leiden tot lagere kosten en kortere levertijden. Op dit moment is NVIDIA nog dominant, dus diversificatie is welkom. Bedenk wel: nieuwe chiparchitecturen vergen tijd om volwassen te worden. Software-ecosystemen (drivers, frameworks) moeten volgen, en dat kan jaren duren. Verwacht geen directe impact op je huidige infrastructuur. Houd de roadmap van MatX in de gaten als je tegen GPU-tekorten aanloopt of als cloud-rekenkracht te duur wordt voor jouw use case.

|

Google voegt Gemini-agents toe aan OpalGoogle heeft Gemini-agents geïntegreerd in Opal, zijn platform voor identiteits- en toegangsbeheer. De agents kunnen nu automatisch toegangsverzoeken reviewen, risicoanalyses uitvoeren en aanbevelingen doen voor least-privilege-instellingen. Dit versnelt securityprocessen: in plaats van dat IT-teams handmatig elke aanvraag beoordelen, screent de agent op basis van historische patronen en compliance-regels. Dat scheelt wachttijd voor medewerkers en vermindert menselijke fouten. Let op: AI-gedreven toegangsbeslissingen vereisen strikte audittrails en een fallback naar menselijke review bij edge cases. Anders riskeer je dat verkeerde toegang wordt verleend zonder dat iemand het opmerkt. Als je Opal gebruikt of overweegt: test de Gemini-integratie met een kleine groep gebruikers en monitor false positives/negatives in de eerste maand nauwlettend.

|