Verzonden op 05-02-2026 07:18

NASA's Perseverance-rover plant eigen route op Mars met Claude AINASA's Perseverance heeft de eerste volledig autonome rit op Mars afgelegd, waarbij Anthropic's Claude orbitale beelden analyseerde en een route door Jezero Crater uitstippelde zonder menselijke tussenkomst. De rover legde ruim 450 meter af terwijl Claude veilig terrein identificeerde (rotsen goed, zandduinen slecht) en navigatiebeslissingen nam—een doorbraak voor missies waarbij de communicatievertraging met aarde 20 minuten bedraagt. Dit lost een fundamenteel probleem op: realtime beslissingen nemen op plekken waar je niet snel hulp kunt inroepen. Voor organisaties die AI inzetten in remote of autonome operaties (denk aan offshore-installaties, mijnbouw, of logistiek in afgelegen gebieden) toont dit aan dat multimodale AI-modellen complexe omgevingsanalyse aankunnen zonder permanent toezicht. Wel belangrijk: de missie draait op vooraf getrainde modellen zonder live updates, dus fouten kunnen niet snel worden gecorrigeerd. De afweging tussen autonomie en controle blijft. |

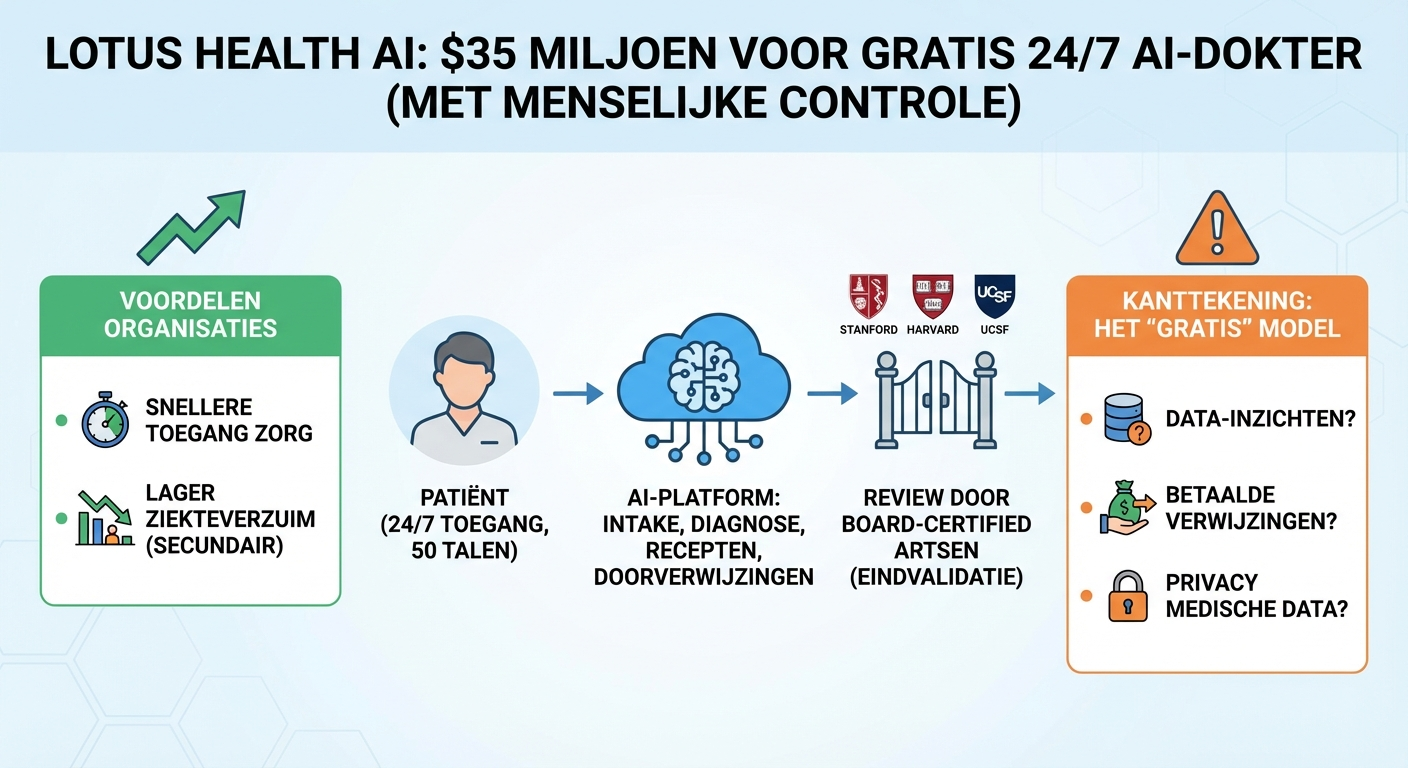

Lotus Health AI haalt 35 miljoen dollar op voor gratis 24/7 AI-dokterLotus Health AI kondigde op 3 februari 2026 een investeringsronde van 35 miljoen dollar aan om een AI-aangedreven eerstelijnszorg-platform uit te rollen dat diagnoses stelt, recepten voorschrijft en doorverwijzingen regelt—allemaal gratis voor patiënten. Het systeem werkt in 50 talen, is gelicenseerd in alle Amerikaanse staten, en laat board-certified artsen van Stanford, Harvard en UCSF alle eindconclusies reviewen. Voor organisaties met werknemers in de VS kan dit de toegang tot gezondheidszorg versnellen en secundaire ziekteverzuimkosten verlagen, zeker voor teams zonder standaard werkuren. De combinatie van AI-intake en menselijke eindvalidatie balanceert schaalbaarheid met medische veiligheid. De kanttekening: gratis betekent meestal dat het businessmodel elders zit—denk aan data-inzichten of verwijzingen naar betaalde diensten. Houd in de gaten hoe Lotus dit gaat monetizen en wat dat betekent voor privacy van medische data.

|

Sam Altman onthult opvolgingsplan: OpenAI overgeven aan AI-modelIn een recent profiel licht OpenAI-CEO Sam Altman toe dat het bedrijf een scenario overweegt waarin de leiding van OpenAI uiteindelijk wordt overgedragen aan een AI-model. Daarnaast claimt hij dat OpenAI "eigenlijk al AGI heeft gebouwd", terwijl interne bronnen waarschuwen dat de organisatie misschien te veel hooi op de vork neemt. Dit soort uitspraken zetten de toon voor discussies over AI-governance en roepen vragen op over checks-and-balances als algoritmes strategische beslissingen gaan nemen. Voor bestuurders en compliance-teams wordt het steeds belangrijker om na te denken over wie verantwoordelijk is als een AI-systeem besluit neemt met grote impact. Actie: Check of je eigen AI-toepassingen helder eigenaarschap en beslissingsbevoegdheid documenteren—wie mag een aanbeveling overschrijven, en onder welke voorwaarden? Zeker in sectoren met strenge regelgeving is die papieren trail goud waard.

|

AI-safety rapport: risico's niet langer theoretischEen nieuw AI-veiligheidsrapport stelt vast dat de risico's van AI-systemen de theoretische fase zijn gepasseerd en meetbaar worden in praktijksituaties. Hoewel de bronmails geen details geven over welke organisatie het rapport publiceerde of specifieke incidenten noemen, sluit de timing aan bij groeiende zorgen over AI-hallucinaties, bias in besluitvorming en onbedoelde escalatie in autonome systemen. Voor organisaties die AI inzetten in klantcontact, hr-processen of financiële beslissingen betekent dit: risk assessments zijn geen nice-to-have meer. Incidenten met reputatieschade, juridische claims of verkeerde uitgaven worden concreter naarmate AI dieper in operationele processen verweven raakt. Denk na over een rollenspel met je team: wat gebeurt er als jullie chatbot een onjuiste medische tip geeft, of een sollicitant ten onrechte afwijst? Documenteer die scenario's en test je noodprocedures voordat het echt misgaat.

|