Verzonden op 08-12-2025 08:21

Gedichten ontgrendelen AI-modellen: 62% van systemen faalt voor poëtische 'jailbreak'Een nieuwe studie toont aan dat poëzie kan worden gebruikt om de veiligheidsbarrières van taalmodellen te omzeilen. Bij de test faalde 62% van de systemen door ongewenste content te produceren na een poëtische prompt. Dit is een onverwachte aanvalsvector die de subtiele kwetsbaarheden in de 'guardrails' van AI-systemen blootlegt. Voor organisaties die AI inzetten in klantgerichte applicaties, onderstreept dit het risico op misbruik via creatieve input. Hoe zorg je ervoor dat je AI-deur op slot blijft als de sleutel een sonnet is? Hoewel de techniek effectief is in een onderzoekssetting, zullen de AI-labs hun verdediging hierop waarschijnlijk snel aanpassen. |

OpenAI roept 'code red' uit na dalend gebruik en opkomst concurrentieOpenAI heeft op 1 december 2025 intern een 'code red' afgekondigd om de kwaliteit van ChatGPT te verbeteren. De ingreep volgt op een daling van het webverkeer met 6% en de opkomst van sterke concurrenten als Anthropic's Claude 4.5 en Google's Gemini 3. Deze ontwikkeling komt op een moment dat veel gebruikers de outputkwaliteit van ChatGPT als afnemend ervaren, terwijl alternatieven juist volwassener worden. Voor organisaties die zwaar leunen op ChatGPT wordt het cruciaal om de prestaties te blijven monitoren en alternatieve modellen te overwegen. De dominantie van één model is niet langer vanzelfsprekend; een multi-model strategie wordt de norm. Een daling van 6% is significant, maar komt van een extreem hoge piek. Het is een teken van normaliserende concurrentie, niet per se een permanente neergang. Actie-tip: Herhaal een complexe taak die je zes maanden geleden in ChatGPT uitvoerde. Vergelijk de output met het origineel en voer dezelfde taak uit in Claude 4.5. Beoordeel objectief of de kwaliteit en nuance zijn veranderd. |

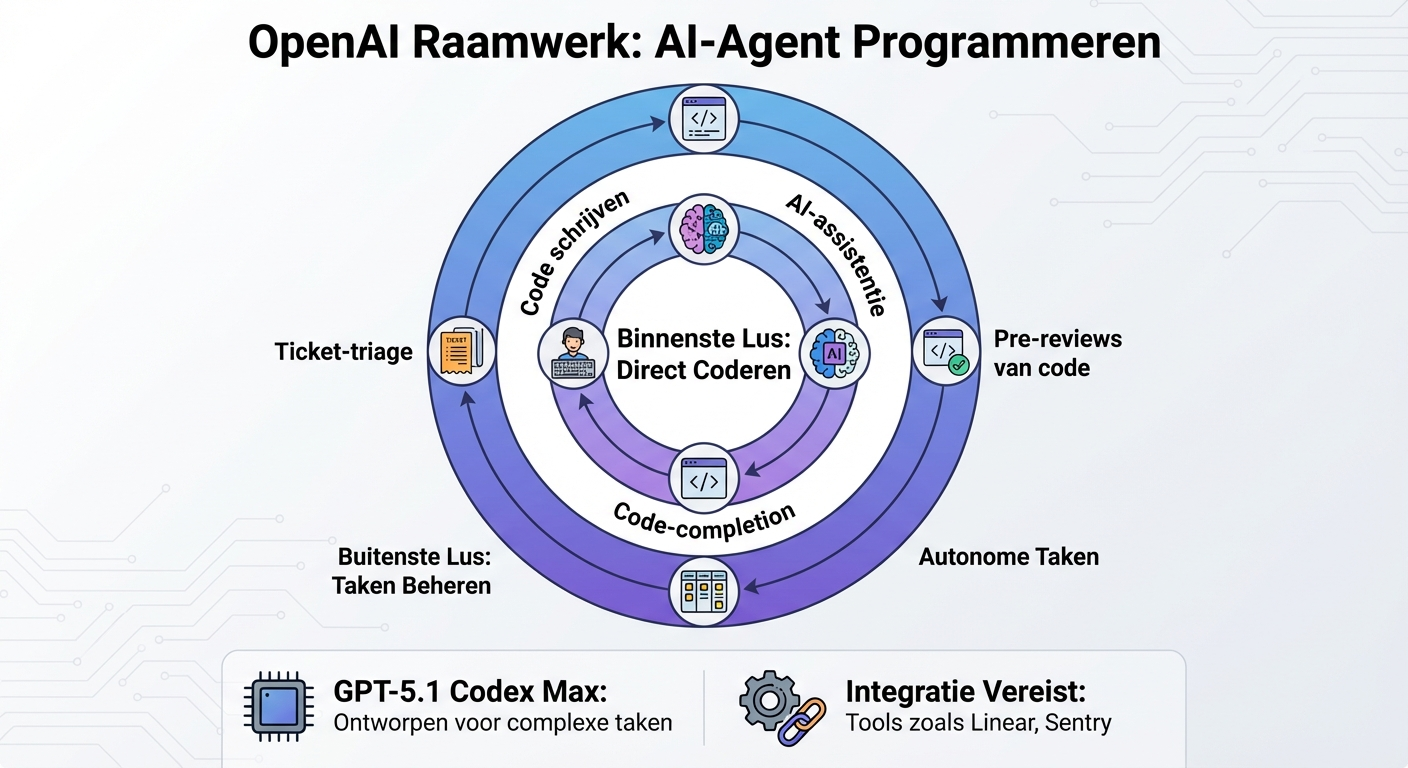

OpenAI onthult raamwerk voor effectief programmeren met AI-agentsIn een recent interview deelde OpenAI's product lead voor Codex een raamwerk voor het ontwikkelen met AI, opgesplitst in een 'Inner Loop' voor direct coderen en een 'Outer Loop' voor het managen van taken zoals ticket-triage en pre-reviews van code. Dit verschuift de focus van simpele code-completion naar een meer gestructureerde, 'agentic' aanpak waarbij de AI complexe, meerstaps taken autonoom uitvoert. Voor ontwikkelteams biedt dit een concrete structuur om productiviteit te verhogen en de werkdruk op senior ontwikkelaars te verlagen. Het nieuwe GPT-5.1 Codex Max-model is specifiek ontworpen voor deze complexere taken. De effectiviteit van de 'Outer Loop' hangt echter sterk af van de integratie met tools als Linear en Sentry, wat een initiële investering in de setup en configuratie vereist.

|

Jeff Bezos' AI-startup Prometheus koopt General Agents voor $6,2 miljardPrometheus, de tot nu toe geheimzinnige AI-onderneming van Jeff Bezos, heeft de startup General Agents overgenomen in een deal van $6,2 miljard. De overname signaleert een strategische focus op 'agentic computing': AI-systemen die niet alleen redeneren, maar ook software en fysieke systemen autonoom kunnen besturen. Dit is een forse investering in de toekomst van AI voor fysieke operaties, zoals productie en logistiek. Voor organisaties in deze sectoren toont het de richting aan: de volgende golf van AI zal zich richten op het automatiseren van complexe, real-world processen, ver voorbij de chatbot. De praktische implementatie van zulke autonome agenten in complexe, veiligheidskritische omgevingen als fabrieken is een enorme uitdaging die nog jaren van ontwikkeling zal vergen. |

Privacy-deceptie bij slim toilet: Kohler gebruikt misleidende encryptieclaimsFabrikant Kohler ligt onder vuur omdat zijn Dekoda slimme toilet-camerasysteem van $599 ten onrechte claimt 'end-to-end encryptie' te gebruiken, terwijl het bedrijf zelf toegang houdt tot de gevoelige beelden en data. Dit voorval is een schoolvoorbeeld van 'privacy washing' en toont de risico's van onduidelijke communicatie over databeveiliging. Voor elke organisatie die data verzamelt, is de les helder: wees technisch precies en transparant over je encryptiemethoden. De privacy-policy staat zelfs toe dat de data wordt gebruikt voor AI-training en gedeeld met derden. Het probleem is niet het gebrek aan encryptie, maar de misleidende claim dat de data voor het bedrijf zelf onleesbaar is. Actie-tip: Analyseer de privacy-policy van één van je eigen AI-leveranciers. Zoek specifiek naar de termen 'encryptie', 'AI-training' en 'delen met derden'. Voldoet de technische realiteit aan de marketingbelofte? |

AI-startup Harmonic lost 30 jaar oud wiskundig probleem op in zes uurHet AI-model 'Aristotle' van startup Harmonic heeft zelfstandig Erdős Problem #124 opgelost, een wiskundig vraagstuk dat al 30 jaar openstond. Het model had slechts zes uur nodig en werkte zonder menselijke input. Dit is een concrete demonstratie van de groeiende capaciteit van AI voor complex, abstract redeneren in een domein dat voorheen exclusief menselijk was. Hoewel dit een academische prestatie is, toont het de potentie van gespecialiseerde AI voor R&D in de wetenschap, engineering en farmacie. Het verkort de tijd voor het doorrekenen van complexe hypothesen van decennia naar uren. De oplossing bleek achteraf relatief simpel, wat de prestatie iets minder spectaculair maakt. Desondanks vond de AI de oplossing wel volledig autonoom. |